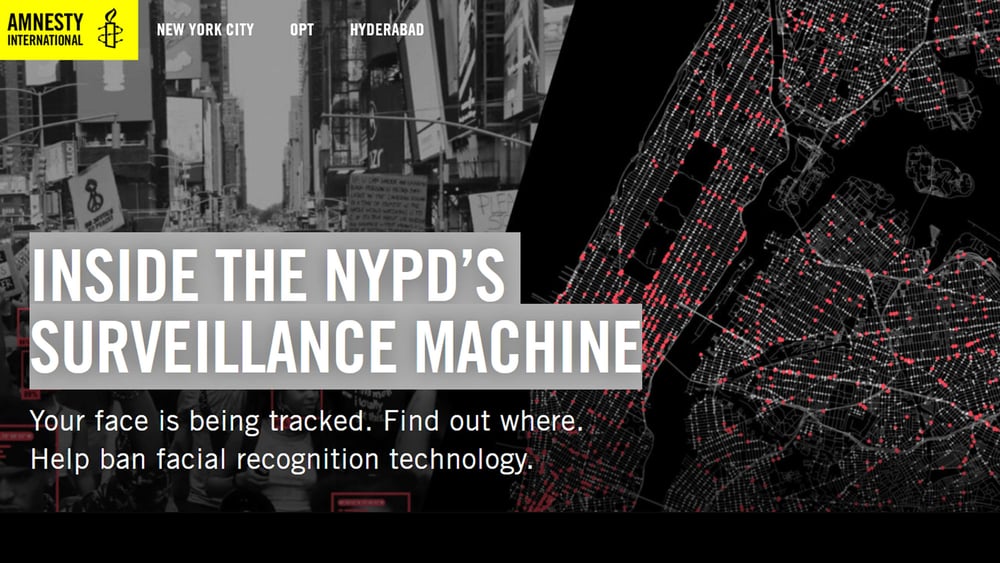

Ban the Scan - Inside the NYPD’s Surveillance Machine

Sorveglianza

In breve

Il riconoscimento facciale solleva diverse questioni in materia di diritti umani:

Questa tecnologia consente infatti la sorveglianza negli spazi pubblici, alla quale le persone toccate non possono dare il proprio consenso. Questo minaccia il diritto all’anonimato e può portare a uno Stato di sorveglianza totale, in particolare se il riconoscimento facciale viene utilizzato dalle autorità.

A causa di software difettosi, persone innocenti possono essere erroneamente scambiate per sospetti e finire nel mirino della polizia, con gravi conseguenze. Inoltre, gli algoritmi sono addestrati principalmente su immagini di uomini bianchi. Di conseguenza, riconoscono meno bene le persone con la pelle più scura, le donne, i bambini e le persone anziane. Questo aumenta il rischio di identificazione errata per le persone appartenenti a questi gruppi.

Inoltre, il riconoscimento facciale viene sempre più utilizzato per controllare le minoranze o gli oppositori, come già avviene in Cina. Anche nei Paesi occidentali questa tecnologia è oggetto di critiche a causa delle potenziali restrizioni alla libertà di espressione durante le manifestazioni.